생성형 AI와 데이터 편향성 문제: 데이터 편향이란 무엇이며 어떻게 해결할 수 있을까?

챗GPT와 Stable Diffusion과 같은 생성형 AI가 우리 일상 속에 광범위하게 활용되면서 학습 데이터의 편향과 환각현상(Hallucination) 등 다양한 문제가 부각되고 있다. 예를 들어 이미지 생성 AI인 Stable Diffusion에 'unprofessional한 사람의 이미지'를 그려달라고 요청하면 '고령의 흑인 남성'과 같은 특정 인종과 성별을 반영한 이미지를 그려내는 것과 같은 문제가 발생하고 있는 것이다.

지난 8월 미국의 워싱턴포스트에서는 정치적 중립을 표방하는 여러 생성형 AI가 특정 정치 성향을 띄고있다는 분석을 내놓기도 했다. 워싱턴포스트는 영국 이스트엥글리아 대학의 연구 사례를 소개하며 챗GPT나 LLaMA와 같은 초거대언어모델(LLM)에게 정치 및 경제 문제에 대한 62가지의 질문을 던지고 ‘긍정’ 혹은 ‘부정’으로 답하도록 지시받았을 때, 뚜렷하게 다른 경향성을 보여준다고 한다.

연구에 따르면 OpenAI사의 챗GPT는 ‘진보’적인 성향에 가까운 답변을 많이 내놓았던 반면, LLaMA의 답변은 비교적 ‘보수’에 가까운 경향성을 보였다는 것이다. 흔히 우리는 인공지능을 떠올릴 때 감정이 개입되지 않으며 철저히 이성적인 판단을 내린다고 생각한다. 그러나 여러 연구조사 결과를 통해 알 수 있듯이 인공지능은 생각보다 중립적이지 않은 경우가 많다. 그렇다면 왜 이러한 문제가 발생하는 것일까?

데이터 편향성 문제란?

생성형 AI는 기본적으로 방대한 양의 학습 데이터에 의존하여 판단을 내린다. 즉, 머신러닝 알고리즘이 학습용 데이터로 구축된 이미지와 텍스트 데이터셋을 바탕으로 새로운 이미지나 텍스트를 생성해 내기 때문에, 편향된 학습용 데이터의 영향을 받을 수밖에 없는 것이다. 이처럼 편향된 데이터에 의한 생성형 AI 결과물의 편향 문제를 데이터 편향성 문제라고 한다.

글의 서두에 살펴본 대표적인 이미지 생성 AI인 Stable Diffusion의 경우, 편향된 학습 데이터를 통해 'unprofessional’ 한 사람은 고령의 흑인 남성이 많다고 학습하고 일종의 고정관념을 가지게 된 것이다. 결국 생성형 AI 역시 사람이 개발하는 것이기 때문에, 사람이 의식하고 편향 없는 인공지능 개발을 위해 노력하지 않는 이상 우리 사회의 문제점을 고스란히 반영하는 인공지능을 만들어내게 되어버리는 것이다.

생성형 AI의 편향을 없애기 위한 방법

이처럼 생성형 AI가 우리의 삶에 미치게 될 파급력을 고려하면 생성형 AI의 편향 문제는 매우 심각한 문제가 아닐 수 없다. 아직은 초기 단계에 머물러 있는 생성형 AI 기술은 앞으로 더욱더 발전할 것이며, 이에 대한 대응과 개선을 위해 다음과 같은 노력이 필요하다.

1. 데이터 전처리 및 균형 유지

흔히 학습 데이터의 분포가 일정한지는 머신러닝 및 딥러닝 모델의 성능을 평가하는 주요한 지표 중 하나이다. 그러나 고른 분포의 데이터 학습은 생성형 AI의 편향을 줄이기 위해서도 매우 중요하다. 데이터 전처리 기술을 통해 특정 그룹이나 특성에 치우치는 경향을 줄이는 방법이 있다. 예를 들어, 데이터셋에서의 특정 그룹의 빈도를 균형 있게 유지하는 등의 조치를 취할 수 있다.

2. 다양성 있는 학습 데이터 수집

데이터의 전처리 및 균형을 유지하기 위해서는 다양한 출처와 다양한 사람들에 의해 만들어진 학습 데이터를 사용하는 것이 중요하다. 다양성 있는 데이터셋은 생성형 AI 모델이 여러 관점을 학습하고 일반화하는 데 도움이 되기 때문이다.

3. 평가 및 감독

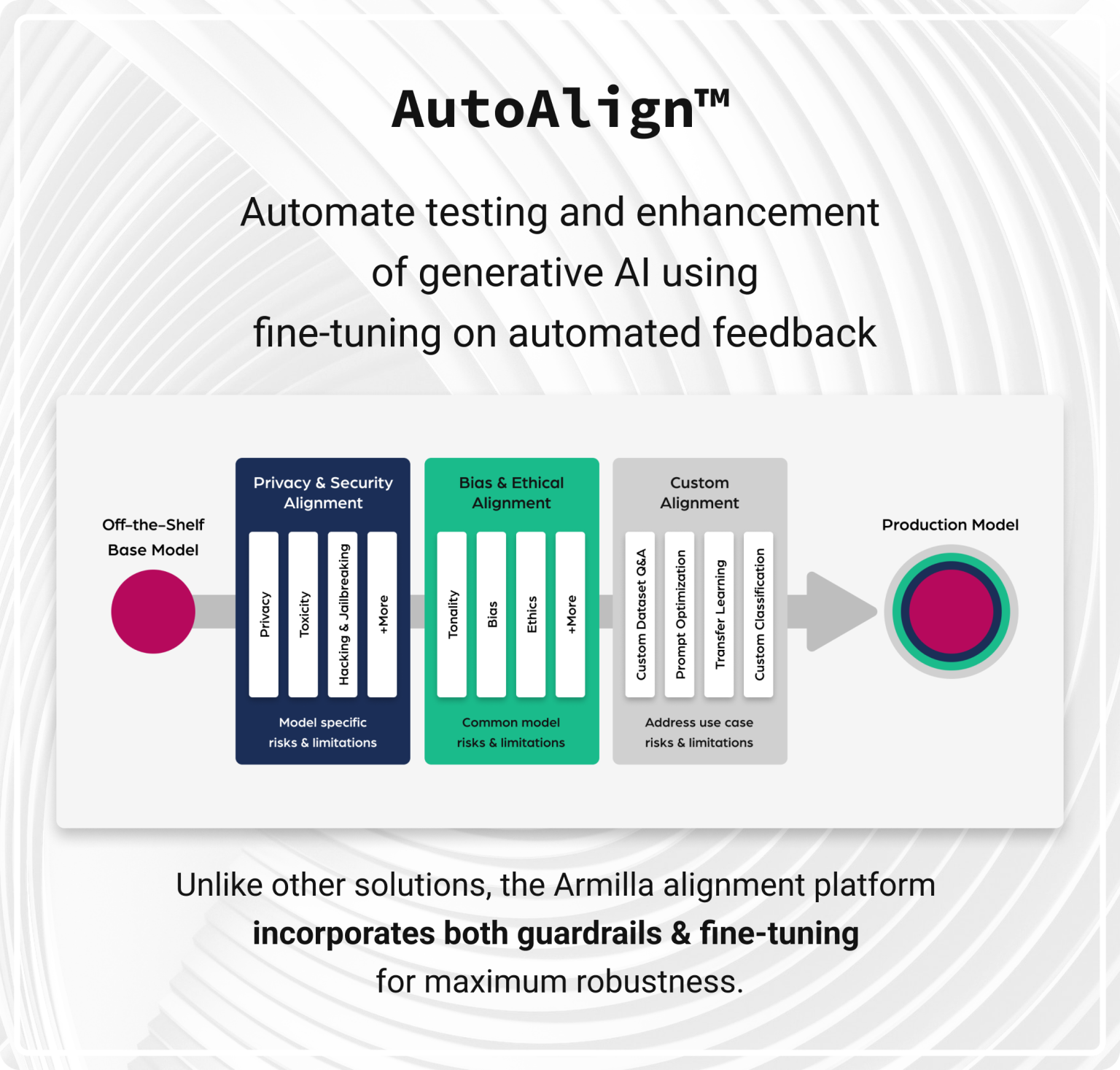

생성된 결과물을 지속적으로 평가하고 감독하여 편향성을 식별하고 개선하는 것이 중요하다. 이를 위해 인간의 개입이 필요한 평가 체계나 보정 메커니즘을 도입할 수 있는데, 최근에는 이러한 생성형 AI의 편향성을 평가 및 감독하기 위한 솔루션 제품들도 많이 등장하고 있다.

4. 투명성과 책임

AI 모델의 작동 방식과 결정 과정에 대한 투명성을 제공하고 책임을 물을 수 있는 프레임워크와 규제가 필요하다. 이는 AI를 개발하고 사용하는 기업과 개발자들에게 책임감을 부여하고, 투명성을 제공하여 문제를 식별하고 해결하는 데 도움이 된다.

편향성 문제는 쉽게 해결할 수 있는 문제가 아니며, 지속적인 노력과 다양한 영역에서의 협력이 필요함이 분명하다. 그러나 이러한 노력들은 향후 생성형 AI의 편향성을 줄이고 보다 공정하고 다양성 있는 결과물을 제공하는 데 도움이 될 것이며, 생성형 AI가 보편화된 시대를 살아가게 될 우리에게 있어서 중요한 과제가 될 것이다.

| ||

문과 출신으로 AI 스타트업에서 데이터 사이언티스트로 일하고 있습니다. |

* 슈퍼브 블로그의 외부 기고 콘텐츠는 외부 전문가가 작성한 글로 운영 가이드라인에 따라 작성됩니다. 슈퍼브 블로그에서는 독자분들이 AI에 대한 소식을 더 쉽고 간편하게 이해하실 수 있도록 유용한 팁과 정보를 제공하고 있습니다.