차문수 슈퍼브에이아이 CTO “제로샷 모델로 비전 AI 에코시스템 구축 목표”

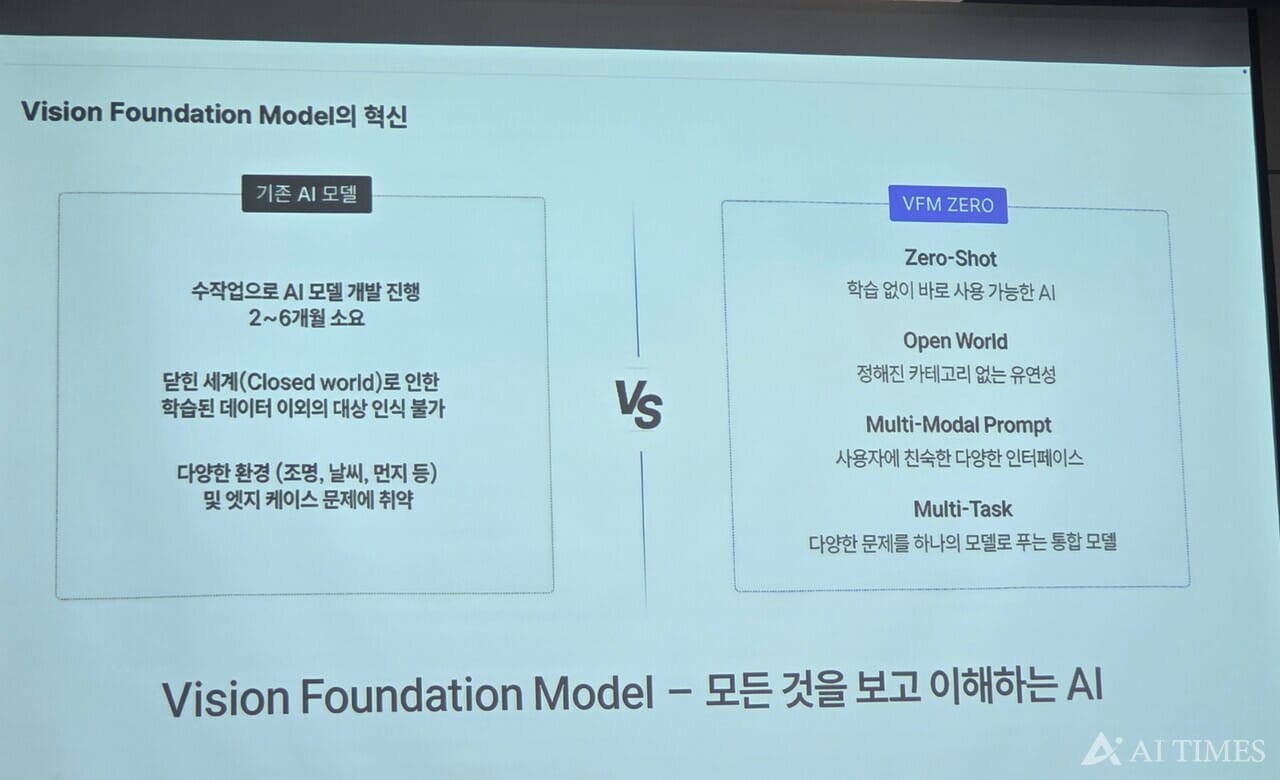

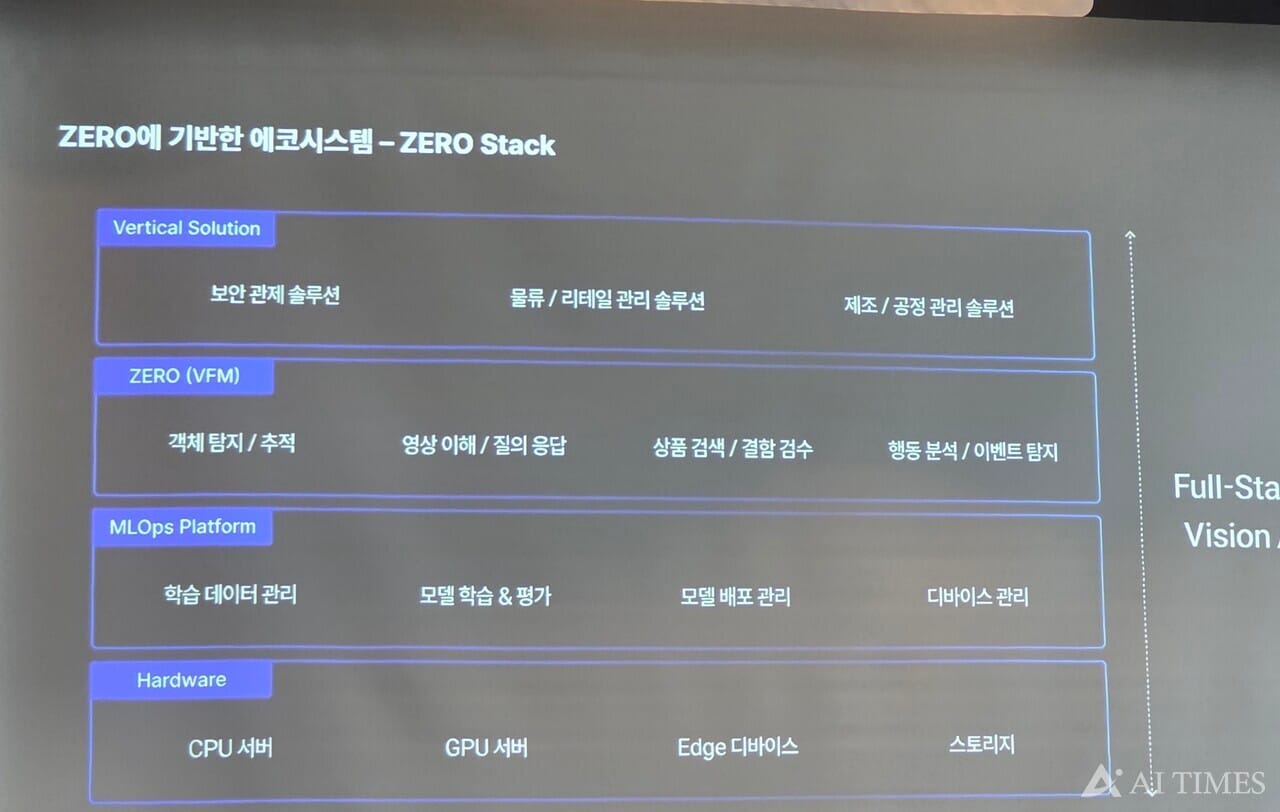

슈퍼브에이아이는 추가 데이터 학습 없이 즉시 AI 도입이 가능한 제로샷 비전 모델 '제로(ZERO)'를 공개했습니다. 기존 2주 걸리던 AI 도입 시간을 제로로 단축하는 혁신적인 기술입니다. 텍스트나 이미지 입력만으로 학습하지 않은 환경에서도 문제 해결이 가능하며, 제조·물류 산업의 업무 효율성을 크게 향상시킵니다. GPU 8만장으로 8개월 만에 개발을 완료했으며, 향후 LLM과 결합한 에이전틱 AI 구현을 목표로 하고 있습니다. 당사는 산업 특화 파운데이션 모델을 통해 비전 AI 에코시스템 구축을 추진하고 있습니다.

슈퍼브에이아이(대표 김현수)는 창립 초기 데이터 라벨링으로 국내외에서 이름을 날린 뒤 비전 인공지능(AI) 한길에 집중해 왔다.

기업의 AI 도입을 돕는 올인원 '슈퍼브 플랫폼'을 구축했으며, 이후 학습 데이터 부족 문제를 해결하기 위한 합성 데이터 기술을 개발했다. 그리고 지난 24일에는 드디어 비전 파운데이션 모델 '제로(ZERO)'까지 공개했다.

제로는 제로샷(Zero-shot) 모델이다. 추가 데이터 학습 없이, 기업이 AI 도입에 걸리는 시간을 제로로 만들겠다는 의미다. 이제까지 산업 현장에 비전 AI를 도입하기 위해서는 추가 데이터 학습으로 적어도 2주가 걸렸던 것을 감안하면 획기적인 일이다.

이는 슈퍼브에이아이가 오래전부터 목표로 했던 일이다. 에이전틱 AI는 제로샷 모델이 필수적이기 때문이다. 즉, 학습하지 않은 처음 접하는 환경에서도 문제를 분석하고 해결할 수 있어야만 자율 에이전트로 역할을 할 수 있다.

24일 간담회 현장에서도 제로샷 모델에 대한 기술 설명이 집중됐다. 해외에서도 아직 쉽게 볼 수 있는 편이 아니다.

차문수 CTO는 “제로샷 비전 모델은 이미지를 ‘텍스트 데이터 관점’에서 맵핑한다고 보면 이해가 쉬울 것”이라고 설명했다.

사람의 인지 능력에 비유할 수도 있다고 덧붙였다. 예를 들어, 서울 광화문을 처음 방문하는 관광객이라도 어떤 건물이 음식점이고, 어느 곳이 차도이고 인도인지, 쓰레기를 버리는 곳이 어디인지 등을 파악하는 것은 어렵지 않다.

이처럼 제로샷 모델은 이미지 데이터를 개념적으로 파악, 학습하지 않은 데이터도 인식이 가능하다는 내용이다.

이는 슈퍼브에이아이의 주요 시장인 제조와 물류 산업에서는 매우 중요한 문제다. 작업 내용이 바뀔 때마다 부품 등을 인지하기 위해 매번 데이터 학습을 거친다면 업무 효율이 크게 떨어지기 때문이다.

이때 제로 모델을 활용하면, ‘5mm짜리 나사를 분류해 줘’라는 텍스트나 나사 이미지를 입력하는 것만으로 AI를 곧바로 현장에 투입할 수 있다.

차 CTO는 “궁극적으로 에이전틱 AI를 실현하기 위해서는 대형언어모델(LLM)과 비전 AI, 피지컬 AI 등을 결합해야 한다”라며 “AI가 로봇 등 하드웨어를 통해 행동까지 도출하는 형태가 완성형으로 볼 수 있다”라고 말했다.

이를 위해 비전 모델에 추론 모델을 결합하는 방향도 추진 중이라고 전했다. 차 CTO는 “비전 모델만 단독으로 활용하면 사물 인식까지는 가능해도, 정확한 맥락을 파악하는 데 무리가 있다”라며 “제조 현장 등이 완전 자동화로 나아가기 위해서는 LLM을 결합하는 것이 필수적”이라고 말했다.

그의 설명은 지난해부터 대세로 떠오른 로봇 AI, 즉 피지컬 AI의 방향 그대로다. 로봇의 비디오 카메라를 통해 수신한 영상을 비전-언어모델(VLM)으로 파악하고, LLM은 로봇이 수행할 임무를 생성하는 식이다. 예를 들어 바닥에 떨어진 물건을 카메라로 발견해 이를 '쓰레기'라고 분석한 뒤, 가장 적절한 동작을 추론해 로봇에 쓰레기를 치우도록 명령하는 방식이다. 이 경우 범용성과 확장성이 크게 늘어난다.

이는 이미지를 넘어, 영상에서도 강력한 성능을 발휘할 것으로 전망했다. 전체 맥락을 파악하기 위해 수많은 센서를 설치하고 데이터를 수집하려면 초기 비용이 과다하게 투입될 수밖에 없다. 이때 비전 모델과 LLM을 동시에 활용하면 보고 설명하는 측면을 카메라만으로 쉽게 해결할 수 있다.

슈퍼브에이아이는 이미 영상 분석 솔루션을 개발, 현재 기술 실증(PoC)을 진행 중이다. 이번에 출시한 제로샷 모델에도 영상 분석 기능을 적용할 예정이다.

디지털트윈 기술도 개발 중이다. 산업 현장 전체를 3D 데이터로 매핑하면 작업 동선 최단거리 파악 등이 가능해진다. 작업 효율성 제고를 위해 필수적이다.

하지만 가장 강조한 것은 역시 데이터다. 차 CTO는 “데이터가 중요한 AI 분야에서 제로샷이라는 개념은 매우 파격적”이라며 “하지만 데이터가 AI의 근간이며 가장 중요하다는 사실은 변치 않는다”라고 강조했다. 아무리 뛰어난 모델이 있어도, 데이터를 관리하는 시스템이 갖춰지지 않으면 성능을 극대화할 수 없기 때문이다.

AI 학습을 위한 컴퓨팅 구축을 위해 어려움을 겪었지만, GPU 8만장 만으로 제로샷 모델 개발을 8개월 만에 마칠 수 있었던 것은 데이터 큐레이션과 압축에 집중한 까닭이라고 밝혔다. “비전 AI는 LLM에 비해 데이터가 커서, 테라바이트(TB)를 넘어가는 일도 허다하다”라며 “그만큼 데이터를 압축, 효율적으로 학습하는 데 집중했다”라고 설명했다.

파운데이션 모델 출시에 이어 다음 단계를 준비하고 있다. 그는 “LLM이 워낙 빠르게 발전하고 있어 비전 AI가 다소 더뎌 보이는 것도 사실”이라며 “LLM 학습 기법을 비전 AI에 적용, 새로운 돌파구를 만들기 위해 애쓰고 있다”라고 말했다.

추론 모델의 사고 사슬(CoT)이나 효율성에 초점을 맞춘 전문가 혼합(MoE) 방식 등을 예로 들었다. MoE를 비전 AI에 도입할 경우, 이미지나 영상을 인식하는 과정에서 필요한 전문가 모델만을 호출할 수 있기 때문에 효율을 극대화할 수 있다. 비전 AI에서도 비용은 중요한 요소다.

차 CTO는 “해당 기술이 성공적으로 구현된다면, 지금보다 도전 가능한 산업 분야가 더 늘어날 것”이라며 “세포 사진 등 사람이 인식하기 힘든 분야에도 비전 AI를 적용할 수 있을 것”이라고 말했다.

LLM을 대표하는 ‘챗GPT’처럼, 비디오 모델을 대표하는 킬러 서비스가 나올 수 있을 것으로 전망했다. 효율 문제 등을 해결, 더 많은 산업 현장에서 AI를 활용하도록 돕겠다는 것이다.

이처럼 차문수 CTO는 슈퍼브에이아이가 단순 비전 모델이 아닌 “산업 특화 파운데이션 모델을 지향한다”라고 강조했다. 이를 통해 비전 AI '에코시스템'을 구축하는 것이 목표다

“산업군 중에서는 제로샷 모델이 꼭 필요할 만큼 다양한 상황이 벌어지는 곳이 많다"라며 "이런 분야에 빠른 AI 도입을 위해 필요한 것이 파운데이션 모델"이라고 설명했다.

이어 “GPU 8장만으로 비전 파운데이션 모델을 개발할 수 있었던 것은 엄청난 성과라고 생각한다”라며 앞으로는 이를 고도화하는 데 집중할 것이라고 밝혔다.

“비디오와 3D 데이터까지 확대하는 것은 물론, 엣지 디바이스 특화 버전도 출시할 것”이라며 "비전 모델 활용도 극대로 다양한 산업군에 기여할 것"이라고 강조했다.

슈퍼브에이아이의 비전 파운데이션 모델 '제로'는 아래 AWS 마켓플레이스에서 지금 바로 사용하실 수 있습니다.