컴퓨터 비전 기술이 시각 장애인을 돕는 방법

WHO에 따르면 전세계 최소 22억 명 이상의 사람이 시각 장애를 갖고 있습니다. AI 기반 컴퓨터 비전 기술로 시각장애인을 돕기 위해 다양한 솔루션이 나오고 있는데요. AI 안내견 로봇 Roboguide, 시각 해석 앱 Seeing AI, 스마트 글래스 EyeCane, GPT-4 기반의 Be My Eyes 등의 사례를 살펴보고, 미래에 어떻게 발전할지 전망을 정리해 보겠습니다.

기술의 발전과 함께 우리는 AI가 일상에 미치는 영향을 점점 더 깊이 경험하고 있습니다. 특히, 컴퓨터 비전 기술은 단순한 이미지 인식을 넘어 인간의 삶을 획기적으로 변화시키고 있으며, 그중에서도 시각 장애인을 위한 지원 기술은 가장 주목할 만한 분야 중 하나입니다. 세계보건기구(WHO)에 따르면, 전 세계적으로 최소 22억 명 이상의 사람들이 시각 장애를 가지고 있으며, 이들에게 일상생활은 끊임없는 도전이 됩니다.

하지만 AI 기반 컴퓨터 비전 기술이 이러한 문제를 해결하는 강력한 도구로 떠오르고 있습니다. 최신 기술을 활용한 다양한 AI 솔루션이 등장하면서, 시각 장애인들은 주변 환경을 보다 쉽게 이해하고, 더욱 독립적인 삶을 영위할 수 있게 되었습니다. 본 글에서는 최신 컴퓨터 비전 기술을 바탕으로 시각 장애인을 돕는 다양한 사례를 소개하고, 앞으로의 발전 가능성에 대해 살펴보고자 합니다.

1. 최신 활용 사례

1.1 AI 안내견 로봇 ‘RoboGuide’

글래스고 대학교의 연구진들이 개발한 RoboGuide는 시각 장애인을 위한 차세대 AI 기반 로봇 안내견으로, 실내 환경에서의 정확한 안내 능력으로 주목받고 있습니다. 기존 안내견과는 달리, 첨단 센서 기술과 고도화된 인공지능을 결합하여 복잡한 실내 공간에서도 탁월한 성능을 발휘합니다. 외부에 장착된 정교한 센서 시스템은 주변 환경을 실시간으로 스캔하고 분석하여, 동적으로 변화하는 환경에서도 최적의 경로를 신속하게 계산하고 장애물을 효과적으로 회피합니다.

RoboGuide의 핵심 기능 중 하나는 GPS 신호가 미약한 실내에서도 뛰어난 성능을 보인다는 점입니다. 이는 최신 컴퓨터 비전 기술과 3D 매핑 기술, 그리고 SLAM(Simultaneous Localization and Mapping) 알고리즘의 융합 덕분입니다. 또한, 최신 대규모 언어 모델(LLM) 기술을 탑재하여 사용자와 자연스러운 대화가 가능합니다. 이 AI 시스템은 사용자의 질문을 정확히 이해하고 맥락에 맞는 적절한 응답을 생성할 수 있어, 단순한 경로 안내를 넘어 주변 환경에 대한 풍부한 설명까지 제공합니다.

예를 들어, 헌테리안 박물관에서 진행된 초기 테스트에서 시각 장애인 자원봉사자들을 1층 전시장으로 안내하면서 6개의 주요 전시물에 대한 상세한 음성 설명을 제공했습니다. 이러한 기능은 박물관뿐만 아니라 쇼핑센터, 병원, 대학 캠퍼스 등 다양한 공공장소에서 시각 장애인의 자율성과 접근성을 크게 향상시킬 것으로 전망됩니다. 현재는 프로토타입 단계에 있지만, 지속적인 개선과 테스트를 거쳐 가까운 미래에 상용화될 것으로 기대되고 있습니다.

1.2 AI 기반 시각 해석 앱 'Seeing AI'

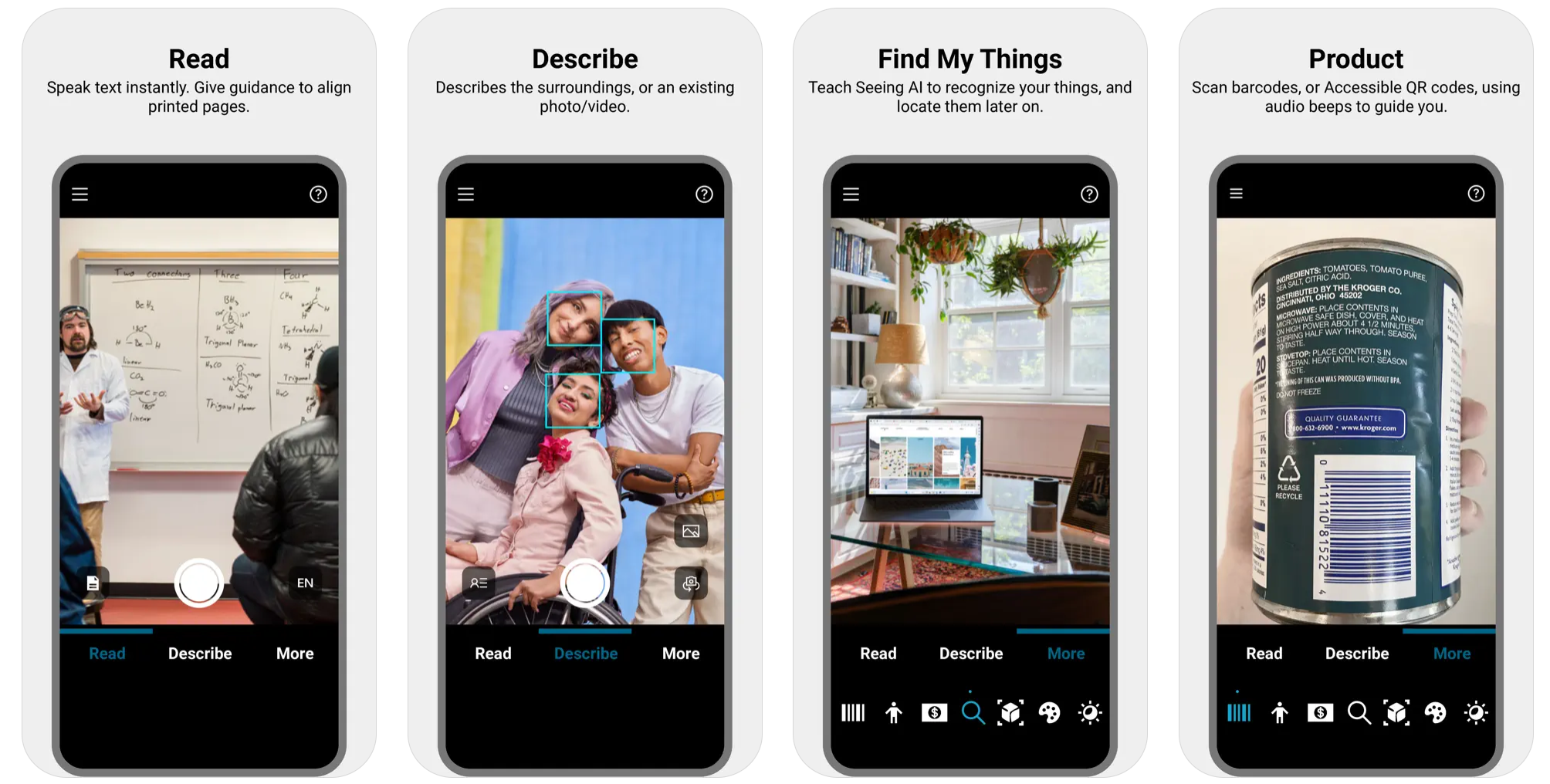

Microsoft가 개발한 Seeing AI는 시각 장애인과 저시력자를 위한 AI 기반 모바일 앱으로, 카메라를 통해 주변 환경을 인식하고 해석하여 음성으로 설명해주는 '디지털 눈' 역할을 합니다. 이 앱은 최첨단 컴퓨터 비전 기술과 인공지능을 결합하여 사용자의 일상생활을 획기적으로 개선하고 있습니다. Seeing AI의 핵심에는 딥러닝 기반의 이미지 인식 모델이 있으며, 이는 Azure Cognitive Services의 Custom Vision Service와 Computer Vision API를 활용합니다.

Seeing AI의 '읽기' 기능은 고급 OCR 기술을 사용하여 문서, 표지판, 제품 라벨 등의 텍스트를 실시간으로 인식하고 음성으로 전달합니다. 특히 주목할 만한 점은 문서 정렬 기능으로, 컴퓨터 비전 알고리즘을 사용하여 문서의 경계를 감지하고 사용자가 최적의 각도에서 촬영할 수 있도록 음성 안내를 제공합니다. '설명' 기능은 최신 이미지 캡션 생성 AI 모델을 사용하여 사진이나 실시간 영상의 상세한 설명을 제공하며, 장면 이해, 객체 관계 분석, 그리고 자연어 생성 기술을 결합하여 풍부하고 정확한 설명을 생성합니다.

'추가' 기능의 '제품' 채널은 바코드와 QR 코드 인식을 위한 컴퓨터 비전 알고리즘을 사용하고, '사람' 채널은 얼굴 인식과 감정 분석 AI를 활용합니다. 이 앱은 교육, 취업, 사회 활동 등 다양한 영역에서 시각 장애인들의 참여를 확대하고, 궁극적으로 그들의 삶의 질을 크게 향상시키는 데 기여하고 있습니다. 컴퓨터 비전과 AI 기술의 발전이 계속됨에 따라, Seeing AI와 같은 앱들은 앞으로 더욱 정교해지고 개인화되어, 시각 장애인들의 독립성과 자신감을 더욱 높여줄 것으로 기대됩니다.

1.3 스마트 글래스 ‘EyeCane’

한국의 스타트업 셀리코에서 개발한 스마트 글래스 'EyeCane'은 시각 장애인들을 위한 혁신적인 AR 안경으로, 컴퓨터 비전과 인공지능 기술을 결합하여 개발되었습니다. 이 제품은 특히 연령 관련 황반변성(AMD), 망막색소변성증(RP), 녹내장 등으로 인한 시력 손실을 겪는 환자들을 위해 설계되었습니다. EyeCane의 핵심 기술은 고성능 4K 카메라와 강력한 이미지 처리 알고리즘의 조합입니다. 이 시스템은 사용자의 시야에서 보이지 않는 영역을 실시간으로 캡처하고, 이 영상 데이터를 EyeCane 모바일 앱의 AI 엔진을 통해 즉시 처리하며, 처리된 이미지는 Full HD AR 렌즈를 통해 사용자의 남아있는 시야 영역에 오버레이되어 표시됩니다.

EyeCane은 또한 OCR(Optical Character Recognition) AI 텍스트 읽기 기능과 YOLOv8(You Only Look Once version 8) 기반 객체 감지 기능을 탑재하여 사용자 경험을 한층 더 향상시킵니다. OCR 기술은 190개 언어를 지원하여 글로벌 접근성을 높이며, 카메라로 촬영한 이미지 속 텍스트를 자동으로 인식하고 읽어줍니다. 예를 들어, 사용자가 식당 메뉴판을 향해 카메라를 비추면 메뉴 내용을 음성으로 읽어줍니다.

YOLOv8 객체 감지 기능은 최신 딥러닝 알고리즘을 사용하여 실시간으로 사용자 주변의 물체를 식별하고 분류합니다. 이를 통해 EyeCane은 사용자 앞에 있는 장애물, 차량, 사람 등을 빠르게 감지하고 음성으로 안내합니다. "앞쪽 3미터에 의자가 있습니다" 또는 "오른쪽에서 자전거가 접근하고 있습니다"와 같은 구체적인 정보를 제공하여 시각 장애인의 안전한 보행과 일상생활을 지원합니다. 이러한 기능들은 시각 장애인들의 독립성과 삶의 질을 크게 향상시키는 데 기여하고 있습니다.

1.4 GPT-4 기반의 가상 자원봉사자 ‘Be My Eyes’

덴마크 기업 Hans Jørgen Wiberg에서 개발한 Be My Eyes는 시각 장애인과 저시력자를 위한 앱으로, OpenAI의 GPT-4를 활용한 'Virtual Volunteer' 기능을 통해 획기적인 시각적 지원을 제공합니다. 이 기능의 핵심은 사용자가 스마트폰 카메라로 촬영한 이미지를 AI에게 전송하면, AI가 이를 분석하고 텍스트로 설명하거나 추가 정보를 제공하는 것입니다. 예를 들어, 냉장고 내부 사진을 업로드하면 AI는 단순히 물건을 식별하는 데 그치지 않고, 해당 재료로 만들 수 있는 요리법을 제안하며, 단계별 조리 가이드를 제공합니다.

Virtual Volunteer의 가장 큰 특징은 기존의 이미지 인식 기술과 달리, 단순히 객체를 식별하는 것을 넘어 이미지 내 맥락과 의미를 이해한다는 점입니다. 예를 들어, 사용자가 특정 상품의 라벨을 촬영하면 AI는 상품 정보를 설명할 뿐만 아니라, 관련된 사용법이나 대체 옵션까지 제안할 수 있습니다. 이는 OpenAI의 GPT-4 기반 이미지-텍스트 변환 모델을 사용하여, 사용자가 제공한 이미지에 대해 문맥을 이해하고 세부적이고 대화형으로 정보를 전달할 수 있기 때문입니다.

Virtual Volunteer는 인간 자원봉사자 서비스와 병행하여 작동하며, AI가 적절한 답변을 제공하지 못할 경우 사용자 요청이 자동으로 인간 자원봉사자에게 연결됩니다. 이를 통해 사용자는 즉각적인 도움과 인간적 상호작용 중 선택할 수 있는 유연성을 갖추게 됩니다. 이러한 접근 방식은 시각 장애인들에게 더 많은 독립성과 정보 접근성을 제공하며, AI 기술의 발전이 실제 생활에서 어떻게 긍정적인 변화를 가져올 수 있는지를 보여주는 좋은 예시입니다.

2. 컴퓨터 비전 기술의 시각 장애인 지원 미래 전망

컴퓨터 비전 기술이 시각 장애인을 돕는 방식은 앞으로 더욱 혁신적으로 발전할 것으로 전망됩니다. 이러한 발전은 시각 장애인의 삶의 질을 향상시키고, 사회 참여 기회를 대폭 확대할 것이며 몇가지 주요 측면에서 살펴보겠습니다.

첫째는, 양자 컴퓨팅과 결합한 초고속, 초정밀 컴퓨터 비전 기술의 발전입니다. 양자 컴퓨터의 연산 능력은 현재의 슈퍼컴퓨터를 훨씬 뛰어넘어, 복잡한 시각 정보를 실시간으로 처리하고 해석할 수 있게 될 것입니다. 이는 시각 장애인용 보조 기기의 성능을 비약적으로 향상시킬 것입니다. 예를 들어, 현재의 객체 인식 기술은 제한된 환경에서만 효과적으로 작동하지만, 양자 컴퓨팅 기반의 컴퓨터 비전 기술은 복잡하고 동적인 실제 환경에서도 거의 완벽한 객체 인식과 장면 이해를 가능하게 할 것입니다. 이를 통해 시각 장애인들은 더욱 안전하고 자유롭게 일상생활을 영위할 수 있게 될 것입니다. 또한, 양자 알고리즘을 활용한 이미지 처리 기술의 발전으로, 현재보다 훨씬 더 선명하고 정확한 이미지를 저시력자들에게 제공할 수 있게 될 것입니다.

둘째는, 뇌-컴퓨터 인터페이스(BCI) 기술과 컴퓨터 비전의 융합입니다. 현재 개발 중인 고급 BCI 기술은 뇌의 시각 피질을 직접 자극하여 시각 정보를 전달할 수 있습니다. 이 기술이 컴퓨터 비전과 결합되면, 카메라로 포착한 이미지를 직접 뇌로 전송하여 시각 경험을 재현할 수 있게 되며, 이는 완전한 시력 상실 상태의 사람들에게도 일종의 '인공 시력'을 제공할 수 있는 혁명적인 발전이 될 것입니다. 예를 들어, 고성능 카메라와 AI 기반 이미지 처리 기술을 통해 주변 환경을 정확히 인식하고, 이 정보를 BCI를 통해 직접 뇌의 시각 중추에 전달함으로써, 시각 장애인들이 실제로 '보는' 것과 유사한 경험을 할 수 있게 될 것입니다. 더 나아가, AI 기술의 발전으로 이 인공 시력은 단순한 이미지 전달을 넘어, 중요한 정보를 강조하거나 불필요한 정보를 필터링하는 등 '지능형 시각'으로 진화할 것입니다.

세번째는, 초소형 웨어러블 디바이스와 AR 기술의 융합입니다. 나노기술과 재료공학의 발전으로 컴퓨터 비전 기술을 탑재한 웨어러블 기기가 극도로 소형화, 경량화될 것입니다. 예를 들어, 콘택트렌즈 형태의 초소형 AR 디스플레이가 개발되어 저시력자들에게 실시간으로 강화된 시각 정보를 제공할 수 있게 될 것입니다. 이 기술은 주변 환경의 콘트라스트를 높이거나, 중요한 객체를 강조하여 표시하는 등 사용자의 잔존 시력을 최대한 활용할 수 있게 도와줄 것입니다. 또한, 초소형 카메라와 AI 프로세서가 내장된 안경 형태의 디바이스는 실시간으로 주변 환경을 분석하고, 음성이나 촉각 피드백을 통해 사용자에게 정보를 전달할 수 있을 것입니다. 이러한 기술의 발전은 시각 장애인들이 보다 자연스럽고 편리하게 일상생활, 교육, 직업 활동 등에 참여할 수 있게 해줄 것입니다.

마지막으로, 멀티모달 AI와 컴퓨터 비전의 통합을 통한 고도화된 환경 인식 및 해석 기술의 발전입니다. 현재의 컴퓨터 비전 기술은 주로 시각적 정보만을 처리하지만, 미래에는 청각, 촉각 등 다양한 감각 정보를 통합적으로 처리하는 멀티모달 AI 시스템이 개발될 것입니다. 이러한 시스템은 시각 장애인에게 더욱 풍부하고 정확한 환경 정보를 제공할 수 있습니다. 예를 들어, 카메라로 캡처한 이미지뿐만 아니라 주변의 소리, 진동, 온도 등을 종합적으로 분석하여 현재 상황을 정확히 파악하고 이를 사용자에게 전달할 수 있습니다. 또한, 자연어 처리 기술의 발전으로 이러한 복잡한 환경 정보를 시각 장애인이 쉽게 이해할 수 있는 형태로 변환하여 전달할 수 있게 될 것입니다. 이는 시각 장애인의 공간 인지 능력과 상황 이해도를 크게 향상시켜, 더욱 자유롭고 안전한 일상생활을 가능하게 할 것입니다.

마무리

컴퓨터 비전 기술의 발전은 시각 장애인들의 삶에 새로운 변화를 가져오고 있습니다. AI 안내견 로봇, 스마트 글래스, 그리고 GPT-4 기반의 가상 자원봉사자와 같은 혁신적인 솔루션들은 시각 장애인들의 독립성과 삶의 질을 크게 향상시키고 있으며 앞으로 양자 컴퓨팅, 뇌-컴퓨터 인터페이스, 초소형 웨어러블 디바이스, 그리고 멀티모달 AI 기술의 발전은 이러한 혁신을 더욱 가속화할 것입니다. 이러한 기술들은 시각 장애인들에게 '인공 시력'을 제공하고, 복잡한 환경에서도 정확한 정보를 전달함으로써, 그들의 사회 참여 기회를 대폭 확대할 것입니다. 우리는 기술의 발전이 모든 이에게 평등한 기회를 제공하는 포용적인 사회로 나아가는 데 중요한 역할을 할 것이라 기대합니다. 앞으로도 연구자들과 기업들의 지속적인 혁신과 사회적 관심이 필요할 것입니다.

| ||

미래를 향한 디지털 여정을 기록하는 작가입니다. |

* 슈퍼브 블로그의 외부 기고 콘텐츠는 외부 전문가가 작성한 글로 운영 가이드라인에 따라 작성됩니다. 슈퍼브 블로그에서는 독자분들이 AI에 대한 소식을 더 쉽고 간편하게 이해하실 수 있도록 유용한 팁과 정보를 제공하고 있습니다.